LeCun不想再忍了!亲口承认要辞职

LeCun不想再忍了!亲口承认要辞职我惊! 图灵奖得主、AI三巨头之一的LeCun在Meta待得是如坐针毡。 Yann LeCun已经直接跟同事表示,自己可能会辞去FAIR首席科学家的职务。

搜索

搜索

我惊! 图灵奖得主、AI三巨头之一的LeCun在Meta待得是如坐针毡。 Yann LeCun已经直接跟同事表示,自己可能会辞去FAIR首席科学家的职务。

上周,福布斯、Wired等争相报道「全球最快开源推理模型」K2-Think,,甚至图灵奖得主Yann LeCun转发推文。但仅三天后,ETH五位研究员的博客如晴天霹雳:87数学评估题竟藏在训练集中!这不仅仅是技术突破,更是行业诚信的警钟。

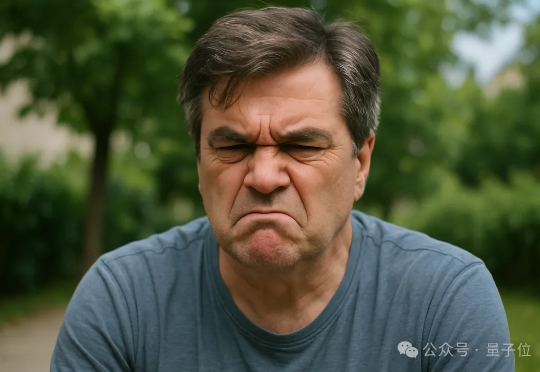

Meta超级智能实验室一拆四以后,首席AI官Alexandr Wang全员信曝光。这位28岁华人获扎克伯格力挺,出任超级智能实验室负责人。内部信强调「超级智能即将到来」,并宣布实验室拆分为四大部门。同时,AGI Foundations团队被解散,成员分流。Yann LeCun地位明显降级,权力重心全面向Wang集中。

Yann LeCun的AI故事,纪录片回顾了这位深度学习先驱的四十年历程。从索邦大学的孤独探索,到贝尔实验室发明卷积神经网络、推动支票识别商用,再与Hinton、Bengio共创深度学习革命,他始终坚信机器应学会学习。

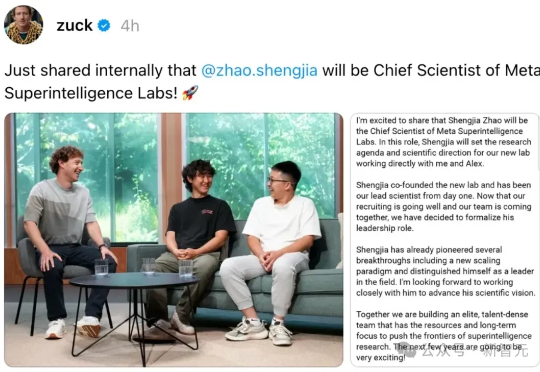

扩展无语言的视觉表征学习。

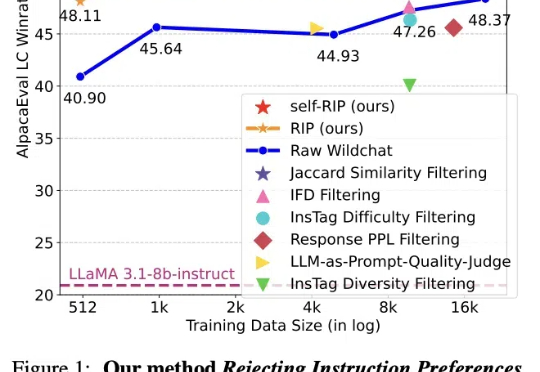

近日,Meta等机构发表的论文介绍了一种通过进化算法构造高质量数据集的方法:拒绝指令偏好(RIP),得到了Yann LeCun的转赞。相比未经过滤的数据,使用RIP构建的数据集让模型在多个基准测试中都实现了显著提升。

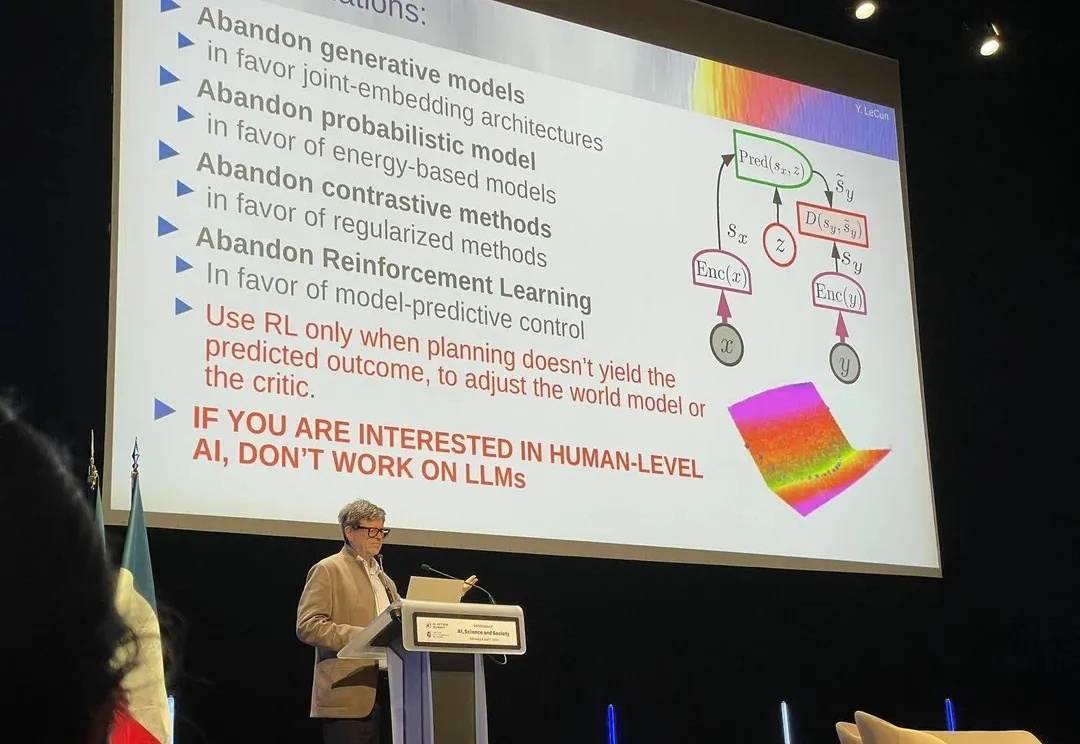

“放弃生成式模型,不研究LLM(大语言模型),我们没办法只通过文本训练让AI达到人类的智慧水平。”近日,Meta首席AI科学家杨立昆(Yann LeCun)在法国巴黎的2025年人工智能行动峰会上再一次炮轰了生成式AI。

在当今的 AI 领域,图灵奖得主 Yann LeCun 算是一个另类。即便眼见着自回归 LLM 的能力越来越强大,能解决的任务也越来越多,他也依然坚持自己的看法:自回归 LLM 没有光明的未来。

1月23日,在第55届世界经济论坛(冬季达沃斯)上,“深度学习”三巨头之一、图灵奖得主、Meta AI首席科学家杨立昆(Yann LeCun),如此对腾讯新闻《一线》透露Meta2025年在AI领域的投资规模。

Meta 的首席 AI 科学家 Yann LeCun 表示,在未来三到五年内将出现一种“新的 AI 架构范式”,远远超出现有 AI 系统的能力。LeCun 还预测,未来几年可能是“机器人时代”,人工智能和机器人技术的进步将结合起来,开启一类新的智能应用。